由淺入深了解NVIDIA全系列產品(一): 你以為 NVIDIA 在賣 GPU,但它其實在賣工廠

Rubin GPU、NVLink、LPU、Spectrum-X CPO——這些名詞你或許聽過,但它們各自在解決什麼問題、彼此之間又是什麼關係?這個系列將以系統架構的視角,由上而下拆解 NVIDIA 如何從晶片供應商演變為垂直整合的 AI 基礎設施平台。

老黃在今年 GTC 用一句話解釋NVIDIA 現在在幹嘛:

「This is your token factory. This is your AI factory. This is your revenues.」

對雲端業者來說,token 就是產品,算力就是產能。工廠多產一個 token,就多賺一筆錢——邏輯直接到有點殘酷。這也是為什麼 AI 伺服器的收入公式可以被簡化成一行:tokens per watt,每浪費一瓦就是少賺一筆錢。

問題是,要讓這座工廠高效運轉,光有 GPU 遠遠不夠。從晶片到機架、從機架內的互連到機架之間的網路,每一個環節都可能成為瓶頸。你不能在某一層省,省了之後其他層的投資全部打折。

NVIDIA 過去十年做的事,就是把這條產線的每一層都補齊——而且全部自己做。這篇文章就是要帶你看清楚,這五層分別在解決什麼問題、彼此之間如何咬合。

拆解 AI 工廠的五個環節

AI 伺服器和你家裡的電腦,本質上在做同一件事:把資料丟進去,算完,把答案吐出來。差別在規模。

你家電腦跑一個試算表,AI 伺服器要同時訓練幾千億參數的模型、或同時服務幾百萬個用戶的推論請求。這不是把電腦「開快一點」就能解決的問題——你必須把一個機架內的幾十顆 GPU 合併成單一計算單元,再把幾百個這樣的機架透過高速網路串在一起,讓整座資料中心變成一台為 AI 而生的超級電腦。

要做到這件事,NVIDIA 把整個系統拆成五個層次,由內往外:

晶片 → 互連 → 機架 → 網路 → 軟體

這五層,NVIDIA 全部自己做,而且每一層都深度整合。

這個系列會用七篇文章把每一層拆開來看,包括技術細節、供應鏈,以及最後一個很多人都在問的問題:GPU 會被 TPU 或其他 ASIC 取代嗎?這篇是 overview,先讓你建立整體框架。

第一層:晶片——算力從這裡來

這是大家最熟悉的部分。GPU 負責跑 AI 運算。

但現代 AI 伺服器裡其實住著五種晶片,不是一種:

CPU (Vera)——負責協調、排程、處理不適合 GPU 做的工作。NVIDIA 有自己設計的資料中心 CPU,專門為 AI 工作負載最佳化,而不是通用型的 Intel 或 AMD 處理器。目前最新的 Vera CPU 搭配 Rubin GPU 組成 Vera Rubin 平台,專為 AI agent 的工具呼叫和資料處理設計。上一代的 Grace CPU 則搭配 Blackwell GPU。

GPU (Rubin)——GPU 和 CPU 的根本差異在於設計哲學:CPU 有少數幾個超強的核心,擅長快速處理複雜、有先後順序的任務;GPU 則有幾千個相對簡單的核心,擅長同時處理大量重複的計算。AI 訓練的本質就是對海量數據反覆做矩陣運算——這正是 GPU 的強項。

DPU(BlueField)——管理資料在機器之間怎麼流動,以及安全性、網路卸載等工作。資料流管不好,GPU 算得再快也是白費,因為它一直在等資料。

CPX(Rubin CPX)——推論的前半段專用加速器。當 AI 要回答一個問題,它要先「讀懂」你給的所有上下文——可能是整份合約、整個程式碼庫、一段長影片。這個「讀懂」的過程叫 prefill,計算量極大。CPX 就是專門為這個階段設計的 GPU 變體,搭載 128GB GDDR7 記憶體和 30 petaFLOPs 的算力,比標準 GPU 處理長上下文的效率高出 3 倍。

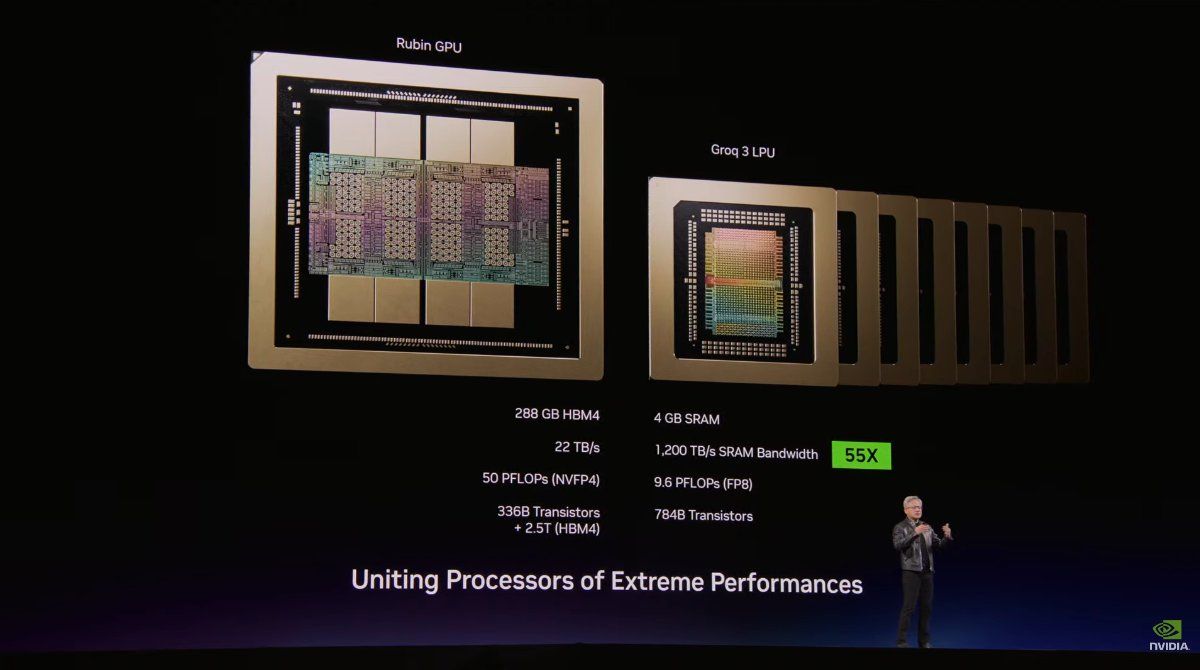

LPU(Groq)——推論的後半段專用加速器。CPX 讀懂問題之後,接下來要「一個字一個字把答案吐出來」,這個階段叫 decode,需要的是極低延遲、極高速度。LPU 就是為這件事生的。NVIDIA 收購了 Groq 的團隊和技術,整合成 Groq 系統,和 GPU、CPX 組成完整的推論流水線。

這五個各司其職,缺一個就會出現瓶頸。這也是為什麼 NVIDIA 不只做 GPU——它要把整條產線上的每個環節都補齊。

第二層:NVLink——把晶片變成一台超大電腦

單顆 GPU 的算力是有上限的。訓練一個大型 AI 模型,光靠一顆不夠,要幾千顆一起跑。

問題來了:幾千顆 GPU 要怎麼溝通?

如果用一般的方式——像電腦連接硬碟那樣——速度根本跟不上。GPU 計算那麼快,資料傳輸卻成了瓶頸,整個系統等著溝通,浪費大半時間。

NVIDIA 的解法叫 NVLink。

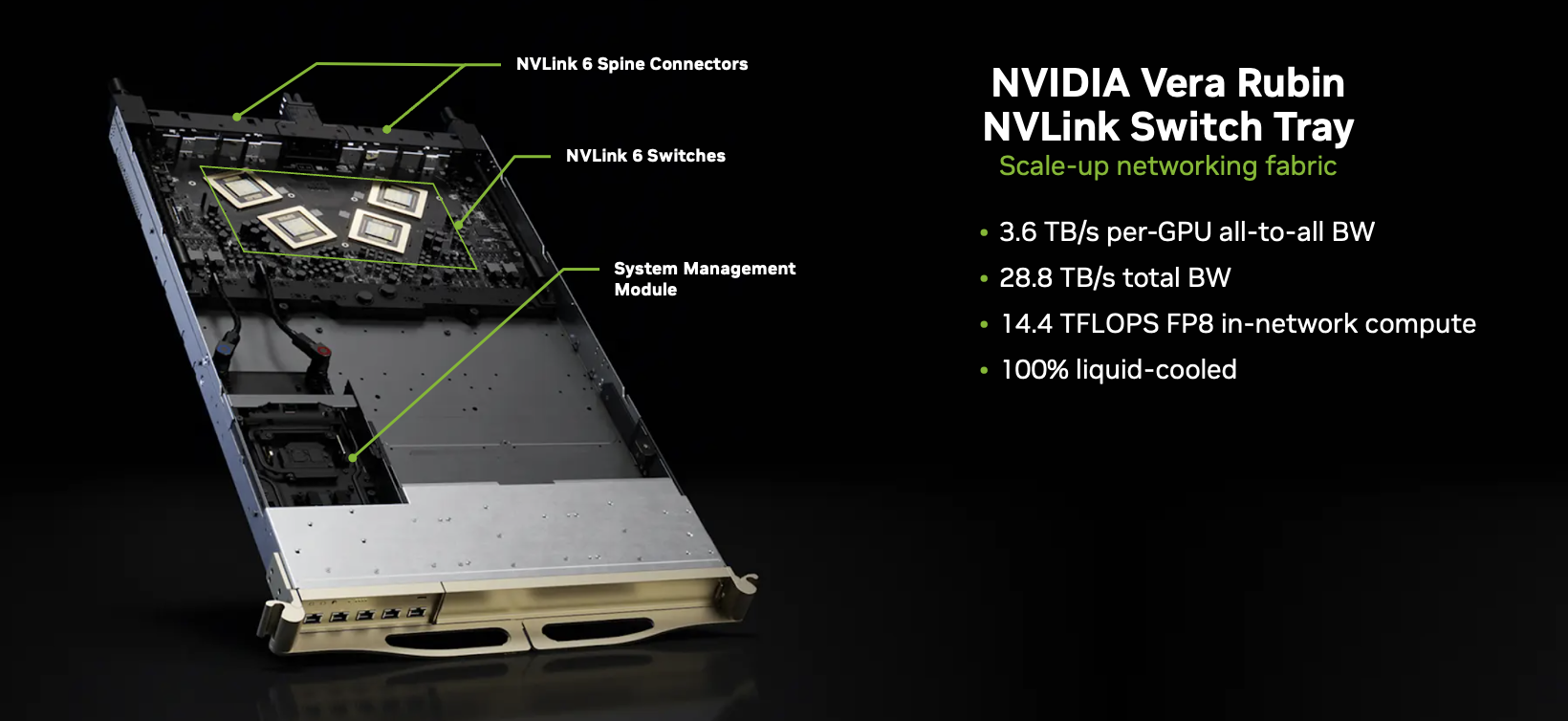

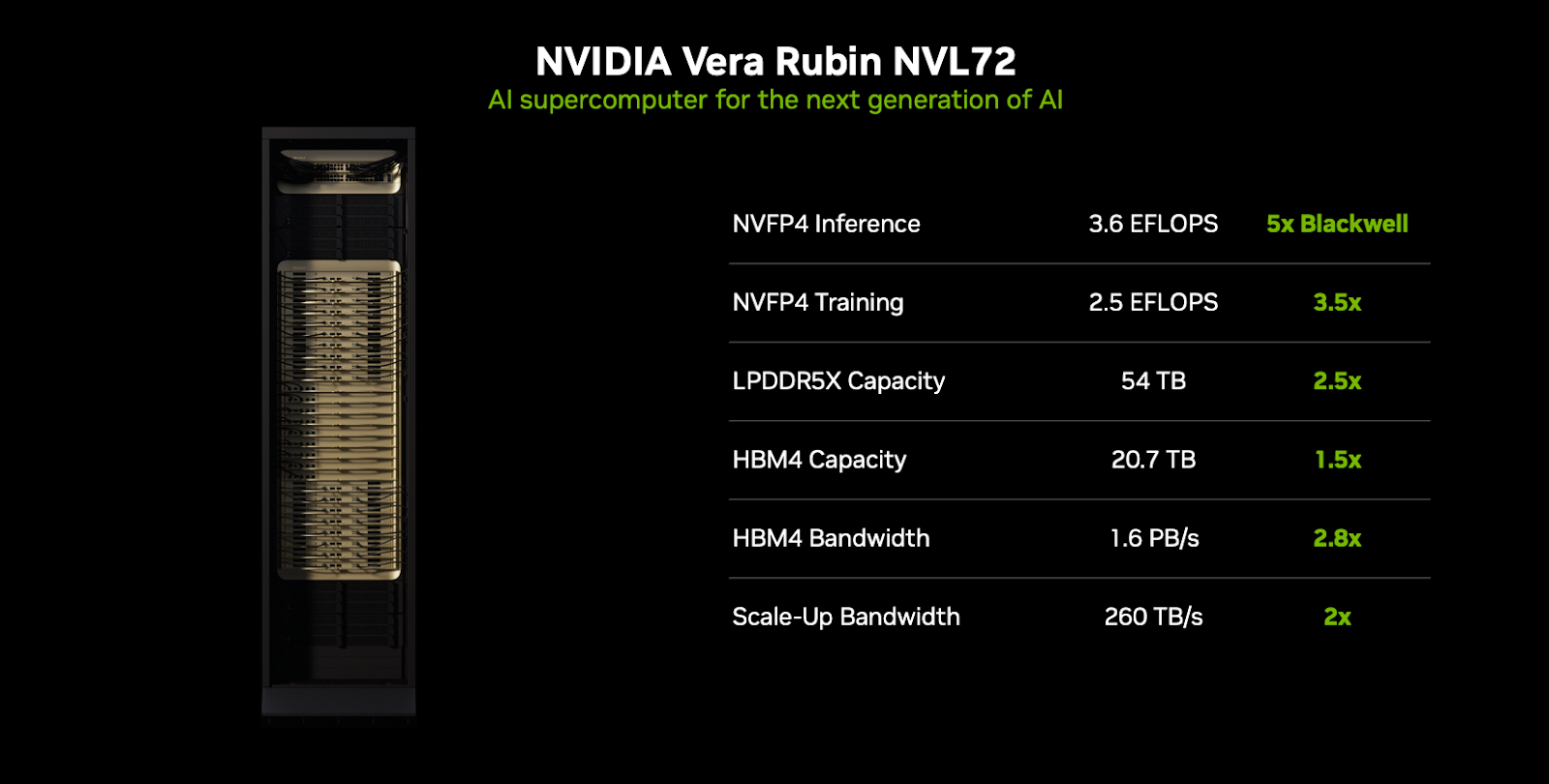

NVLink 是 NVIDIA 自己開發的高速連接技術,專門設計來讓多顆 GPU 之間的溝通速度快到「感覺不出來有邊界」。最新的 Vera Rubin 世代可以把 72 顆 GPU 用 NVLink 串在一起,傳輸速度達到 260 TB/s——這個數字大概是你家網路速度的兩千萬倍。

72 顆 GPU 串起來之後,對外它們就表現得像單一超大型GPU。這讓 AI 模型不需要費心思考「我現在在哪一顆晶片上跑」,直接把整個機架當成一個計算資源池用。

NVLink 每一代都在進化:上一代 Blackwell 是 130 TB/s,Vera Rubin 直接翻倍到 260 TB/s。

這種讓多顆 GPU 共享記憶體、對外表現成單一計算單元,這叫 scale-up。機架和機架之間透過網路傳遞訊息、協調工作,叫 scale-out——那是第四層的任務。

第三層:Rack——機架是產品,不是箱子

把幾十顆 GPU 串好之後,它們要住在哪裡?

答案是機架(Rack)。但 NVIDIA 對機架的定義已經不是「一個放伺服器的金屬框架」——它是一個完整的計算單元,從散熱、電力供應、到內部配線都是整體設計好的。

Vera Rubin 世代的機架有幾個特點值得注意:

100% 液冷。傳統伺服器用風扇吹,噪音大、效率差。液冷直接把冷卻液灌進機架,用 45°C 的熱水帶走熱量——這溫度聽起來很高,但正是這個設計讓機架不需要額外的冷卻設備,省下的能源直接回給計算用。

無纜線設計。以前安裝一個機架要拉幾百條線,需要兩天。新設計把連接都整合進機架本身,安裝時間從兩天縮短到兩小時。

下一代的 Rubin Ultra 更進一步,帶來了全新的 Kyber 機架設計。過去節點是水平插入機架,Kyber 改成垂直插入,透過機架中間的 midplane 直接連接 NVLink——這讓單一機架可以把 144 顆 GPU 串成一個 NVLink domain,是 Vera Rubin 的兩倍。機架本身就是交換器,不需要額外的連接線。

機架是 NVIDIA 交貨給客戶的基本單位之一,不是讓客戶自己買零件組裝。這也是「賣工廠」這個比喻的具體體現——你買的是一個可以直接插電開始運作的計算單元。

第四層:網路——讓機架彼此溝通

一個機架 72 顆 GPU 不夠,可能要幾百個機架同時運作。

機架之間怎麼溝通?這就是Scale-out 網路的任務。

NVIDIA 有兩條網路產品線:

Quantum(InfiniBand)——高速、低延遲,是過去幾年 AI 資料中心的標準配備。適合需要極低延遲、機器之間溝通非常頻繁的訓練工作。

Spectrum(Ethernet)——以太網路架構,但針對 AI 工作負載最佳化。以太網路是全世界最普遍的網路標準,幾乎所有資料中心都有。Spectrum 讓 AI 系統可以建立在這個已有的基礎設施上,同時保持夠好的效能。

兩條產品線標配銅纜,都可以選配 CPO(Co-Packaged Optics,共封裝光學)——把光纖傳輸直接整合進交換器晶片裡,讓訊號不需要先轉成電再轉成光,功耗效率提升 5 倍。Quantum 的 CPO 版本(Quantum-X800)已量產,Spectrum 的 CPO 版本預計 2026 下半年推出。

第五層:軟體(CUDA)——讓硬體真正能用

硬體再強,沒有軟體就是一堆廢鐵。

CUDA 是 NVIDIA 在 2006 年推出的程式設計平台,讓開發者可以直接用 GPU 做通用運算——在這之前,GPU 只能跑圖形相關的工作。這個發明改變了一切,也是後來 AI 訓練能在 GPU 上跑起來的根本原因。

今年是 CUDA 推出 20 週年。20 年下來,CUDA 已經深入幾乎所有的 AI 框架——PyTorch、TensorFlow、JAX 全部建在它上面。全球有幾百萬個開發者、幾十萬個開源專案都在用 CUDA。這個生態系不是砸錢三年就能複製的。

CUDA 之上還有一層叫 CUDA X,是 NVIDIA 針對不同領域開發的演算法庫,目前超過一千個。你可以把它想成 NVIDIA 幫每個行業預先寫好的加速工具——醫療影像、基因體學、金融模擬,每個領域都有對應的庫直接拿來用。

這也是為什麼 NVIDIA 說自己是「演算法公司」,不只是晶片公司。硬體可以被追趕,生態系很難。

為什麼這件事很重要

在 GTC,老黃說他看到 2027 年之前至少有 1 兆美元的確定性需求。去年這個時候他說的是 5000 億,一年之內翻倍。

這筆錢不是只買 GPU。它要買的是整個系統——晶片、NVLink、機架、網路、軟體,一整套。

NVIDIA 已經不是一個零件供應商,它是世界上唯一能把這五層全部打包賣給你的公司。

這個框架是理解後面所有文章的基礎。接下來的系列,我會一層一層拆開來看:每個產品的技術細節是什麼、供應鏈在哪裡、誰在受益。